Pesquisadores de segurança da JFrog descobriram graves vulnerabilidades em ferramentas de aprendizado de máquina (ML) de código aberto amplamente utilizadas, incluindo MLflow, H2O, PyTorch e MLeap. Essas falhas, que abrangem 22 vulnerabilidades reveladas recentemente, podem expor organizações a ataques que comprometem a segurança de seus sistemas e dados.

Diferentemente do primeiro conjunto de falhas divulgadas, que envolviam problemas no lado do servidor, as novas descobertas se concentram em brechas em bibliotecas usadas por clientes de ML. Entre elas, estão falhas em formatos tidos como seguros, como o Safetensors.

Impactos das falhas

Segundo os pesquisadores, a exploração dessas vulnerabilidades pode levar ao sequestro de clientes de ML dentro de organizações, permitindo que invasores realizem movimentos laterais e comprometam serviços importantes, como registros de modelos de ML e pipelines MLOps.

Isso inclui a possibilidade de:

- Exposição de credenciais e dados sensíveis;

- Inclusão de backdoors em modelos armazenados;

- Execução remota de código malicioso.

Lista de vulnerabilidades identificadas

Entre os problemas destacados, incluem-se:

- CVE-2024-27132 (pontuação CVSS: 7,2)

- Falha no MLflow que permite ataque XSS e execução de código remoto em notebooks Jupyter.

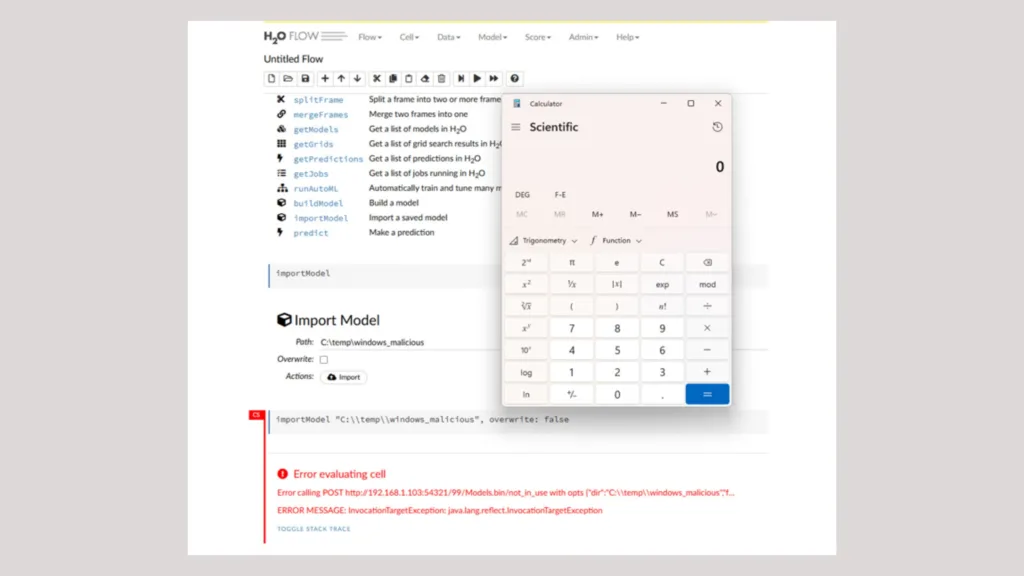

- CVE-2024-6960 (pontuação CVSS: 7,5)

- Desserialização insegura no H2O ao importar modelos de ML, possibilitando execução remota de código.

- Problema no TorchScript do PyTorch

- Travessia de caminho que pode levar a negação de serviço (DoS) ou substituir arquivos críticos do sistema.

- CVE-2023-5245 (pontuação CVSS: 7,5)

- Vulnerabilidade no MLeap ao carregar modelos compactados, resultando em ataques do tipo Zip Slip.

Recomendação dos especialistas

De acordo com Shachar Menashe, vice-presidente de pesquisa da JFrog, o uso de ferramentas de ML, apesar de seu potencial inovador, exige cautela. Ele reforça a importância de nunca carregar modelos não confiáveis, mesmo de fontes aparentemente seguras.

A negligência pode permitir a execução remota de código, resultando em impactos significativos para as organizações. Dessa forma, os especialistas recomendam uma avaliação rigorosa dos modelos utilizados e a adoção de práticas de segurança reforçadas, como a validação de bibliotecas e a higienização de dados.

Conclusão

As vulnerabilidades descobertas alertam para os riscos associados à dependência crescente de ferramentas de ML. Organizações devem priorizar a segurança em seus processos para evitar prejuízos significativos e proteger seus ativos digitais.