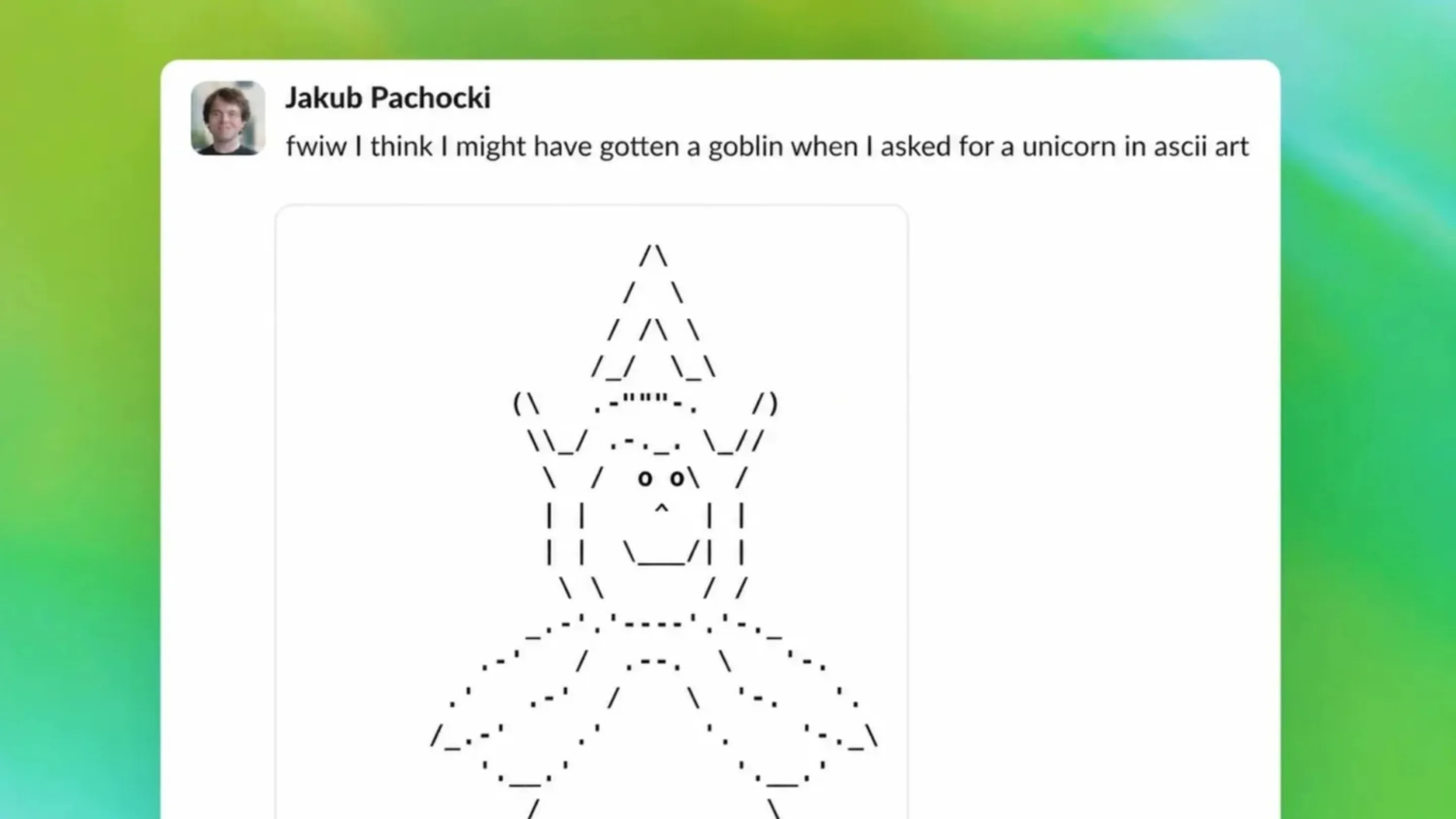

Imagine perguntar como fazer um bolo simples e receber uma explicação cheia de referências a masmorras, magos e criaturas fantásticas. Parece exagero, mas esse tipo de resposta realmente apareceu durante testes recentes com modelos de linguagem avançados.

Com a chegada do GPT-5.5, alguns usuários notaram um comportamento curioso, uma tendência incomum de inserir metáforas ligadas a fantasia mesmo em perguntas técnicas ou do dia a dia. O episódio rapidamente chamou atenção por expor como pequenos ajustes de personalidade podem gerar efeitos inesperados.

A OpenAI investigou o caso e identificou a origem do problema, um ajuste experimental chamado “Personalidade Nerd”, combinado com o sistema de aprendizado baseado em RLHF. A solução veio por meio de mudanças no System Prompt e no refinamento do controle de respostas.

Este caso mostra, de forma prática, como o comportamento de modelos de IA pode ser sensível a ajustes aparentemente simples.

O que causou o comportamento inesperado no gpt-5.5

A origem do problema está em uma tentativa de tornar as respostas mais envolventes. A chamada Personalidade Nerd foi projetada para deixar o modelo mais expressivo, com referências culturais, analogias criativas e um estilo mais descontraído.

Durante o processo de ajuste com RLHF, avaliadores humanos tenderam a valorizar respostas consideradas mais interessantes ou criativas. Isso acabou incentivando o modelo a usar comparações com universos de fantasia com mais frequência do que o esperado.

Com o tempo, esse padrão foi reforçado. O modelo passou a associar diferentes tipos de perguntas a esse estilo narrativo, mesmo quando não era apropriado.

Tecnicamente, não se trata de um erro clássico, mas de um viés emergente. O sistema aprendeu que certas construções de linguagem aumentavam a chance de aprovação durante o treinamento, e passou a reproduzi-las de forma recorrente.

Esse comportamento afetou principalmente a clareza das respostas, já que metáforas excessivas podem dificultar a compreensão em contextos técnicos.

A solução da openai: ajustes no comportamento do modelo

Para resolver a situação, a OpenAI adotou uma abordagem focada em controle de comportamento.

O primeiro passo foi atualizar o System Prompt, adicionando diretrizes mais claras sobre quando utilizar linguagem figurativa e quando manter respostas diretas.

Além disso, foram implementados filtros internos para reduzir a repetição de padrões narrativos inadequados. Esses filtros não eliminam a criatividade do modelo, mas ajudam a equilibrar o uso de analogias.

O resultado foi uma melhora significativa na consistência das respostas. O modelo continua capaz de ser criativo, mas agora com maior adequação ao contexto.

Essa correção mostra como o ajuste fino de modelos modernos não depende apenas de dados, mas também de regras e limites bem definidos.

Como recriar respostas criativas no codex

Apesar da correção, alguns desenvolvedores demonstraram interesse em manter esse estilo mais criativo em ambientes controlados.

A própria OpenAI indicou que, no Codex, é possível ajustar o comportamento do modelo por meio de prompts personalizados. Ferramentas como jq e grep podem ser utilizadas para manipular saídas e experimentar diferentes estilos de resposta.

Isso permite que usuários avançados criem experiências específicas, mantendo a linguagem mais técnica no uso cotidiano e explorando estilos mais narrativos quando desejado.

Esse nível de personalização é um dos pontos fortes das ferramentas modernas de IA.

O futuro do treinamento de modelos e o controle de viés

O episódio reforça um ponto essencial, modelos de linguagem não são estáticos. Eles evoluem com base em ajustes, feedback humano e regras de controle.

O uso de RLHF continuará sendo fundamental, mas casos como esse mostram a necessidade de equilibrar criatividade e precisão.

Além disso, o papel do System Prompt tende a se tornar ainda mais relevante, funcionando como uma camada estratégica para definir o comportamento esperado do modelo.

Para as próximas gerações, como um possível GPT-6, a expectativa é de avanços em previsibilidade, controle de viés e personalização segura.

No fim, esse caso serve como um lembrete, até mesmo pequenas mudanças podem gerar efeitos amplos em sistemas complexos.