As chaves de API do Google sempre foram vistas como um mecanismo relativamente simples de autenticação para serviços como Google Maps e YouTube Data API. Por anos, muitos desenvolvedores consideraram essas chaves seguras o suficiente para uso em aplicações web públicas, desde que limitadas por domínio ou IP.

No entanto, uma mudança recente na arquitetura do Google Cloud alterou drasticamente esse cenário. O que antes era apenas uma chave para exibir um mapa em um site pode agora servir como porta de entrada para recursos avançados do Gemini AI, ampliando privilégios e expondo empresas a riscos financeiros e vazamento de dados.

Milhares de chaves já expostas em repositórios públicos podem ter se tornado vetores de abuso. O impacto vai além da segurança técnica, envolve possíveis cobranças automáticas de alto valor e acesso indevido a dados sensíveis. A descoberta ganhou destaque após uma investigação conduzida pela TruffleSecurity, acendendo um alerta importante para desenvolvedores e equipes de Cybersecurity.

A integração do Gemini API ao ecossistema do Google Cloud elevou o nível de privilégio associado a determinadas chaves, transformando credenciais aparentemente inofensivas em ativos críticos de segurança.

Entenda o problema: De chaves inofensivas a credenciais poderosas

Historicamente, as chaves de API do Google eram utilizadas para autenticar requisições a serviços específicos, como mapas incorporados ou consultas públicas de dados. Mesmo quando vazadas, o dano era geralmente limitado ao consumo indevido de cota, com impacto financeiro relativamente previsível.

Com a integração mais profunda do Gemini API dentro do mesmo projeto no Google Cloud, algumas dessas chaves passaram a herdar permissões mais amplas. Em determinadas configurações, uma chave criada para um serviço aparentemente isolado passou a autenticar chamadas para modelos generativos do Gemini AI.

Do ponto de vista técnico, o problema ocorre quando:

- A chave está associada a um projeto com Gemini API habilitada.

- Não há restrições adequadas de API ou escopo.

- Não existem limites rígidos de uso ou monitoramento ativo.

- A chave foi exposta em código público ou frontend.

Isso significa que um atacante que encontre uma chave exposta pode:

- Consumir recursos do Gemini AI.

- Gerar grandes volumes de requisições.

- Provocar cobranças automáticas elevadas.

- Explorar possíveis dados acessíveis dentro do mesmo projeto.

Essa mudança alterou completamente o perfil de risco do chamado vazamento de API.

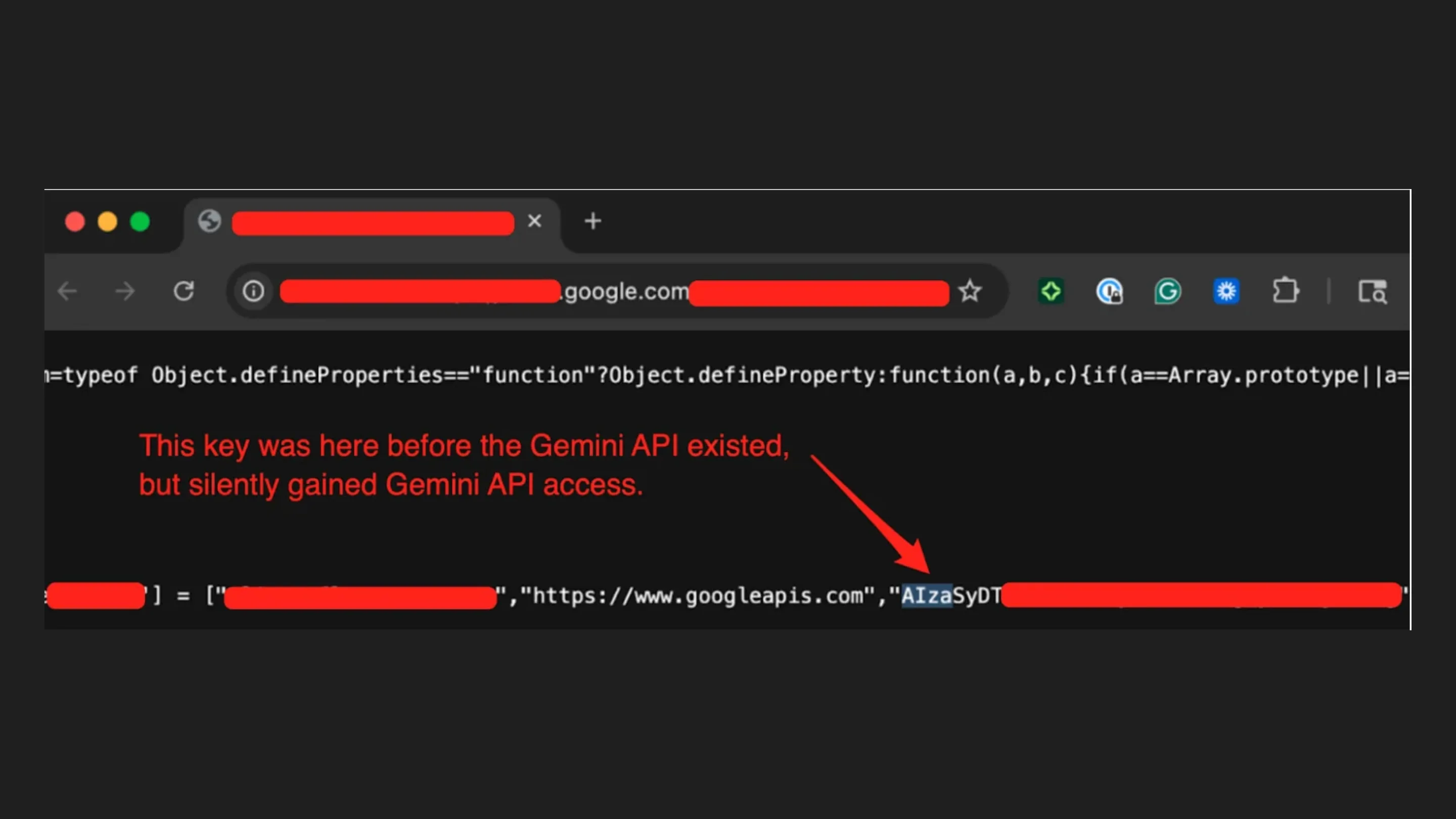

Imagem: TruffleSecurity

O papel da TruffleSecurity na descoberta

A empresa de segurança TruffleSecurity, conhecida pela ferramenta TruffleHog, identificou que diversas chaves públicas em repositórios GitHub continuavam válidas e eram aceitas para autenticação em endpoints ligados ao Gemini API.

O TruffleHog é amplamente utilizado para detectar segredos expostos, como tokens e credenciais em código-fonte. Durante a análise, pesquisadores observaram que chaves antigas, originalmente criadas para serviços como Google Maps, estavam autenticando chamadas relacionadas a modelos de IA generativa.

A descoberta levantou duas preocupações principais:

- O aumento silencioso de privilégios.

- A falta de conscientização da comunidade sobre essa mudança estrutural.

Embora nem todas as chaves fossem automaticamente válidas para o Gemini AI, a existência de configurações permissivas tornou o cenário preocupante.

Os riscos reais para empresas e desenvolvedores

O impacto do problema não é apenas teórico. Ele envolve riscos concretos e imediatos.

1. Exposição de dados

Se o projeto associado à chave tiver integrações adicionais, como armazenamento em Google Cloud Storage ou acesso a serviços internos, uma configuração mal ajustada pode ampliar o alcance do atacante.

Embora a chave de API não substitua credenciais administrativas completas, o uso indevido pode permitir:

- Enumeração de serviços ativos.

- Exploração de endpoints habilitados.

- Consumo de modelos treinados com dados sensíveis.

Esse cenário afeta diretamente a segurança Gemini e exige revisão urgente das práticas de controle de acesso.

2. Prejuízos financeiros significativos

O modelo de cobrança do Google Cloud é baseado em consumo. No caso do Gemini AI, chamadas frequentes a modelos avançados podem gerar custos elevados em curto período.

Um atacante automatizando requisições pode:

- Gerar milhares de chamadas por hora.

- Explorar modelos de maior custo computacional.

- Elevar drasticamente a fatura mensal.

Há relatos de empresas enfrentando cobranças inesperadas de milhares de dólares após exploração de credenciais expostas. Mesmo que parte do valor seja contestado, o impacto operacional e financeiro pode ser severo.

3. Danos à reputação

Uma falha envolvendo chaves de API do Google pode resultar em:

- Divulgação pública de vulnerabilidades.

- Perda de confiança de clientes.

- Investigações internas e externas.

No contexto atual, onde IA generativa está sob escrutínio constante, incidentes ligados ao Gemini AI ganham ainda mais visibilidade.

A resposta do Google e as medidas de mitigação

Após a notificação da TruffleSecurity, o Google Cloud implementou ajustes importantes.

Entre as medidas relatadas estão:

- Reforço nas restrições padrão de novas chaves.

- Recomendações explícitas para limitar escopo de APIs.

- Incentivo ao uso de autenticação baseada em identidade, como contas de serviço.

- Alertas mais claros sobre riscos de exposição.

O Google também reforçou a importância de configurar:

- Restrições por domínio HTTP.

- Restrições por endereço IP.

- Limitação explícita de APIs autorizadas.

- Orçamentos com alertas automáticos.

Apesar dessas melhorias, a responsabilidade final continua sendo do desenvolvedor e da equipe de segurança. A arquitetura do Google Cloud é altamente configurável, e configurações inseguras ainda podem abrir brechas significativas.

Como se proteger: Auditoria e ferramentas

A proteção contra o uso indevido das chaves de API do Google exige uma abordagem estruturada e contínua.

1. Audite todas as chaves ativas

No console do Google Cloud:

- Revise cada chave de API.

- Verifique quais APIs estão habilitadas.

- Remova permissões desnecessárias.

- Desative chaves antigas ou não utilizadas.

Nunca mantenha uma chave ativa sem saber exatamente onde ela é usada.

2. Restrinja o escopo de API

Uma prática essencial é limitar explicitamente quais APIs a chave pode acessar. Se a aplicação usa apenas Google Maps, não há motivo para permitir acesso ao Gemini API.

Esse simples ajuste reduz drasticamente o risco associado a um eventual vazamento de API.

3. Utilize ferramentas como TruffleHog

O TruffleHog, da TruffleSecurity, deve ser integrado ao pipeline de CI/CD para detectar segredos expostos antes que cheguem a repositórios públicos.

Além disso:

- Use varreduras periódicas em código legado.

- Revise forks públicos.

- Monitore commits antigos.

4. Implemente orçamentos e alertas

Configure:

- Orçamentos mensais.

- Alertas de consumo anormal.

- Limites de cota personalizados.

Isso não impede o abuso, mas reduz o impacto financeiro.

5. Adote autenticação mais robusta

Sempre que possível, substitua chaves de API do Google por:

- Contas de serviço.

- OAuth 2.0.

- Controle de identidade baseado em IAM.

Chaves de API são práticas, mas não devem ser a única camada de segurança em aplicações críticas.

Conclusão e o futuro da segurança em APIs de IA

O caso das chaves de API do Google expostas demonstra como mudanças estruturais em plataformas de nuvem podem alterar completamente o modelo de risco de credenciais consideradas seguras.

A integração do Gemini AI ao Google Cloud trouxe avanços impressionantes em inteligência artificial, mas também elevou o nível de responsabilidade dos desenvolvedores. O que antes era uma simples chave para exibir um mapa pode agora representar acesso a recursos de alto custo e potencialmente sensíveis.

A principal lição é clara: nenhuma chave pública deve ser considerada inofensiva.

Revisar projetos, restringir permissões e implementar monitoramento ativo não é mais uma boa prática opcional, é uma exigência de sobrevivência no cenário atual de IA generativa.

Se você utiliza Google Cloud, este é o momento de realizar uma auditoria completa. Verifique suas chaves, limite escopos e adote ferramentas de detecção de segredos imediatamente. O custo da prevenção é infinitamente menor do que o impacto de uma exploração bem-sucedida.