Robôs humanoides vêm ganhando espaço como plataformas versáteis para tarefas de manipulação, locomoção e navegação em ambientes concebidos para pessoas. No entanto, entender esse mundo complexo em três dimensões ainda é um gargalo. Cada fabricante costuma adotar um conjunto diferente de câmeras, sensores e algoritmos, criando sistemas de visão pouco padronizados e propensos a falhas de oclusão, vibração e interferência cinemática dos próprios membros do robô.

A solução: Entendendo o mundo em ‘Voxels’

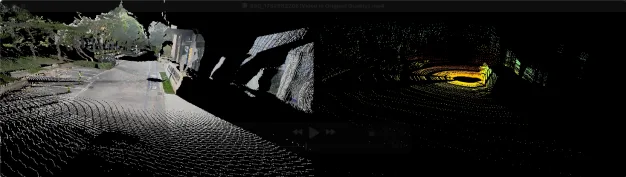

O projeto Humanoid Occupancy, resultado da colaboração entre X-Humanoid e GigaAI, apresenta uma abordagem unificada de percepção por ocupação. Imagine um jogo como o Minecraft, onde o mundo é dividido em blocos. Aqui, o espaço ao redor do robô é particionado em pequenos cubos virtuais — os voxels. Cada voxel armazena se o espaço está “ocupado” ou “livre” e, se ocupado, “por quê”: parede, cadeira, pessoa, etc.

Essa representação 3D densa oferece duas vantagens diretas:

- Fornece ao robô conhecimento geométrico e semântico completo do ambiente — ideal para planejar rotas, evitar obstáculos e posicionar pés ou mãos com precisão.

- Facilita a fusão de múltiplas modalidades de sensores (câmeras RGB, sensores de profundidade e LiDAR) em uma malha espacial única, reduzindo ambiguidades de profundidade e aumentando a robustez em condições de iluminação variáveis.

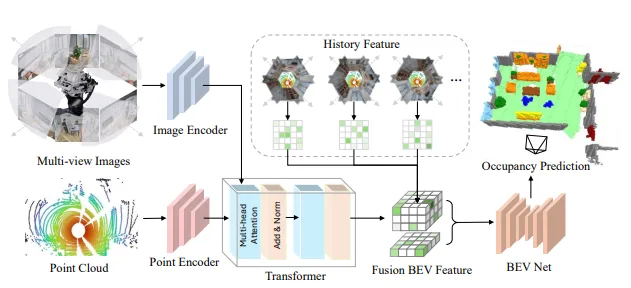

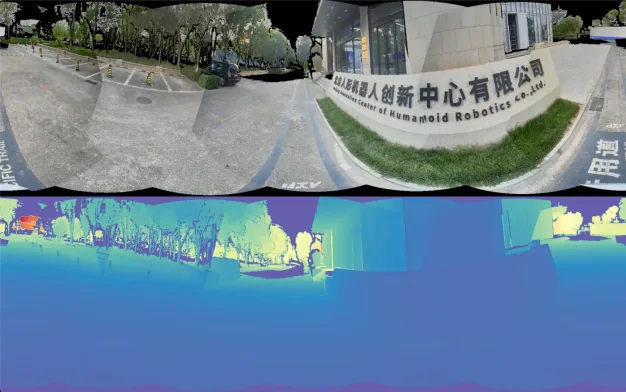

Na prática, o sistema do Humanoid Occupancy equipa o robô Tienkung com seis câmeras RGB estrategicamente distribuídas e um LiDAR de 360 °, todos alinhados a um pipeline de IA inspirado nos carros autônomos. Uma rede neural de fusão multimodal transforma esses dados crus em um mapa de ocupação 3D em tempo real, superando problemas de oclusão e instabilidade durante movimentos articulares.

Um novo dataset para impulsionar a pesquisa

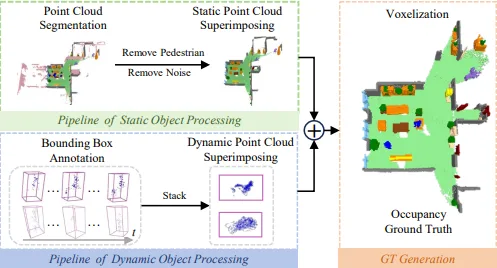

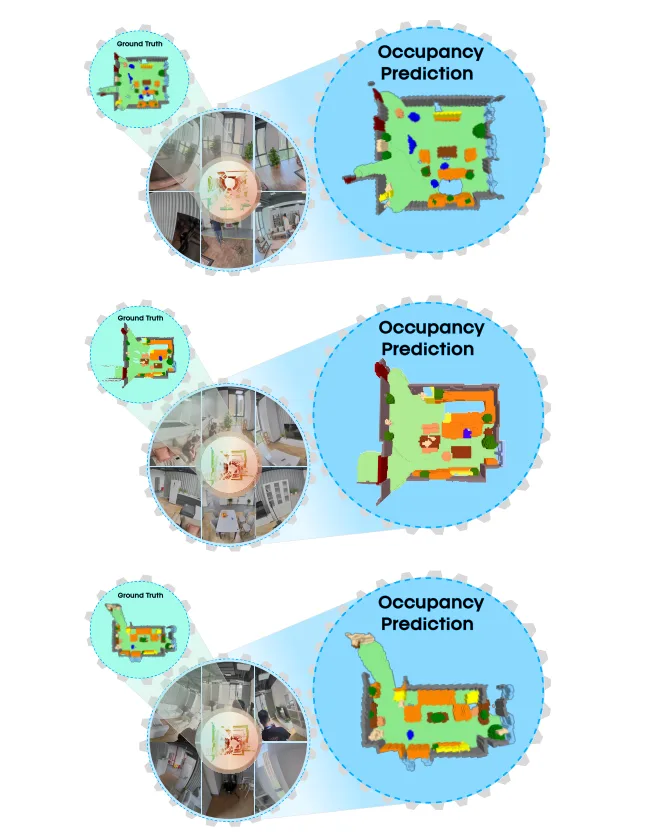

Além do sistema em si, a equipe criou o primeiro dataset panorâmico de ocupação específico para robôs humanoides. Usando um headset vestível com os mesmos sensores do Tienkung, pesquisadores coletaram cenas domésticas, industriais e externas, anotadas voxel a voxel com categorias como chão, parede, móveis e pedestres.

Esse recurso abre caminho para que outros laboratórios testem algoritmos sob um padrão comum, acelerando a evolução de robôs humanoides capazes de operar em ambientes reais.

Conclusão

Humanoid Occupancy vai além de uma melhoria incremental: ele propõe um formato padrão de percepção que combina hardware otimizado, IA de fusão multimodal e um dataset público especializado. É um passo decisivo rumo à padronização e generalização dos sistemas de visão em robôs humanoides, aproximando-os da operação confiável e segura em cenários complexos do nosso dia a dia.