A Inteligência Visual da Apple está se consolidando como uma das peças mais estratégicas da Apple Intelligence no iOS 26. Depois de dar os primeiros passos analisando imagens, textos e capturas de tela para extrair informações úteis, a tecnologia pode evoluir para algo ainda mais prático: integrar-se diretamente ao app Lembretes e transformar prints em tarefas acionáveis. Se confirmada, essa integração não seria apenas mais um recurso incremental, mas um salto significativo na forma como interagimos com o iPhone no dia a dia.

Para usuários que vivem de organização digital, produtividade e fluxos rápidos de informação, essa mudança pode representar o fim do processo manual de copiar dados de uma captura de tela para criar tarefas. E é exatamente aqui que a Inteligência Visual da Apple mostra seu potencial real.

O estado atual da Inteligência Visual da Apple

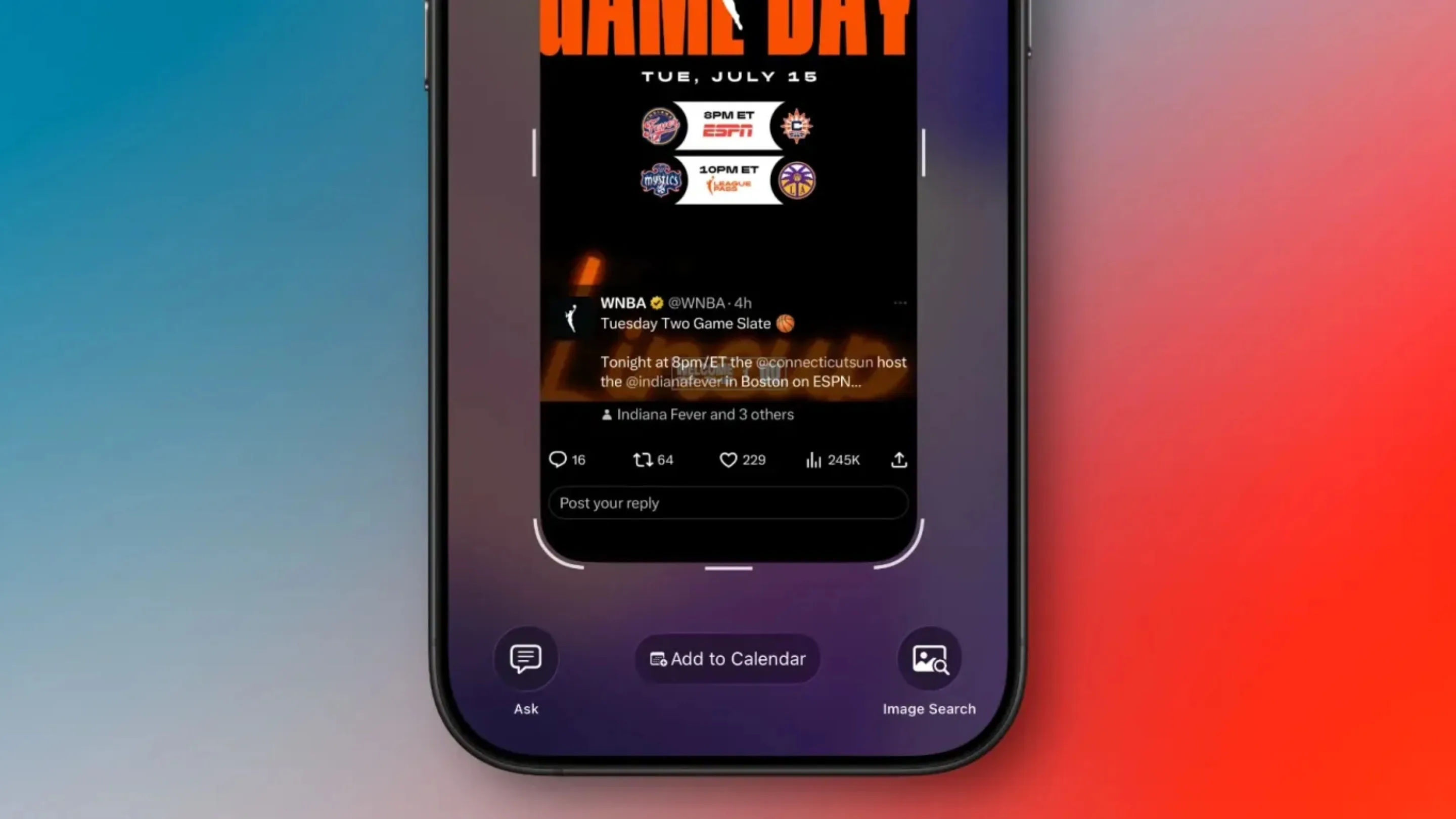

Hoje, a Inteligência Visual da Apple já é capaz de interpretar elementos dentro de imagens e capturas de tela. No iOS 26, a tecnologia consegue identificar datas e sugerir eventos no Calendário, reconhecer endereços, extrair textos relevantes e até permitir consultas contextuais com apoio do ChatGPT, quando necessário.

Na prática, isso significa que ao tirar um print de um convite com data e horário, o sistema pode sugerir automaticamente a criação de um evento no Calendário. Da mesma forma, ao capturar a tela com informações de um restaurante, o iOS pode identificar o endereço e facilitar a navegação.

Esse processamento ocorre de maneira contextual e, sempre que possível, com foco em privacidade, executando tarefas diretamente no dispositivo. A proposta é clara: reduzir fricção e antecipar necessidades do usuário.

No entanto, existe uma lacuna evidente. Nem toda informação extraída de uma captura de tela se encaixa como evento de calendário. Muitas vezes, o que o usuário precisa é de um lembrete simples, rápido e acionável.

Por que integrar o app Lembretes é o próximo passo lógico

A integração da Inteligência Visual da Apple com o app Lembretes parece um movimento natural na evolução da plataforma. O conceito por trás disso pode ser entendido como um “favorito universal” para informações importantes capturadas na tela.

Imagine alguns cenários comuns:

- Um print de uma promoção com prazo limitado.

- Uma captura de tela com um código de rastreio.

- Um trecho de conversa com uma tarefa pendente.

- Uma lista de itens enviada por mensagem.

Hoje, o usuário precisa alternar manualmente entre apps, copiar informações e criar um lembrete. Com a Inteligência Visual da Apple, o sistema poderia analisar a captura de tela, identificar uma possível ação e sugerir automaticamente: “Deseja criar um lembrete com base nesta informação?”

Essa automação simplificaria drasticamente o fluxo de trabalho. Em vez de depender da memória ou de etapas repetitivas, o iPhone passaria a atuar como um assistente proativo. A captura de tela deixaria de ser apenas um arquivo estático e se tornaria uma ponte para ações concretas.

Para profissionais que lidam com múltiplas tarefas, estudantes e usuários avançados do ecossistema Apple, isso pode representar ganho real de produtividade. A Inteligência Visual da Apple deixaria de ser apenas interpretativa e se tornaria operacional.

Desafios técnicos da análise contextual

Apesar do entusiasmo, integrar a Inteligência Visual da Apple ao app Lembretes não é uma tarefa trivial. Criar eventos de calendário é relativamente simples do ponto de vista da IA: datas e horários são elementos objetivos. Já os lembretes envolvem intenção.

Um exemplo ajuda a ilustrar o desafio. Se uma captura de tela mostra a frase “Comprar presente da Ana”, a intenção é clara. Mas e se o print trouxer apenas uma conversa com múltiplos tópicos? Como o sistema decide o que deve virar tarefa?

A análise contextual exige compreensão semântica mais profunda. A IA precisa distinguir entre informação relevante, comentário casual e algo que realmente demanda ação futura. Esse tipo de inferência envolve processamento de linguagem natural mais avançado e modelos capazes de entender nuances.

Além disso, existe a questão da experiência do usuário. Sugestões excessivas podem gerar fadiga e frustração. Sugestões insuficientes reduzem o valor percebido da funcionalidade. Encontrar esse equilíbrio é essencial para que a Inteligência Visual da Apple seja vista como útil e não intrusiva.

Outro ponto crítico é a privacidade. Como a Apple posiciona sua estratégia de IA com forte ênfase em processamento local, integrar análise de contexto mais complexo sem comprometer desempenho e segurança é um desafio técnico considerável.

Inteligência Visual da Apple e o futuro da interface

Se implementada de forma eficiente, a integração com Lembretes pode redefinir a maneira como interagimos com o sistema operacional. A interface tradicional, baseada em abrir apps e executar ações manualmente, começa a dar lugar a uma camada inteligente que interpreta intenções.

A Inteligência Visual da Apple pode se tornar o elo entre o que vemos e o que fazemos. A tela deixa de ser apenas exibição de conteúdo e passa a ser um espaço dinâmico de captura e transformação de informação.

Isso se alinha a uma tendência mais ampla na indústria de tecnologia: interfaces cada vez mais contextuais e preditivas. Em vez de esperar comandos explícitos, o sistema sugere caminhos com base no comportamento e no conteúdo visualizado.

Para o público entusiasta de tecnologia e produtividade, essa evolução representa um passo importante rumo a um iOS mais inteligente e integrado. Para a Apple, é também uma forma de reforçar seu posicionamento em IA mobile, com diferenciais baseados em privacidade e integração profunda entre hardware e software.

Conclusão

A evolução da Inteligência Visual da Apple mostra que a empresa está interessada em ir além do reconhecimento básico de imagens. A possível integração com o app Lembretes aponta para um cenário em que capturas de tela se transformam automaticamente em tarefas acionáveis, reduzindo etapas e aumentando a eficiência.

Embora existam desafios técnicos relevantes, especialmente na interpretação de intenção e no equilíbrio das sugestões, o potencial é claro. Estamos diante de uma mudança que pode alterar a lógica de interação com o iPhone, tornando o dispositivo mais proativo e alinhado às necessidades do usuário.

Se a Inteligência Visual da Apple cumprir essa promessa, o iOS poderá se aproximar ainda mais da ideia de assistente pessoal inteligente, discreto e eficiente.