Sem sombra de dúvidas, estamos na era da Inteligência Artificial (IA), e alguns perigos não são mais fictícios. Os arquitetos de inteligência que trabalham hoje com IA podem, potencialmente, ser os que causam (ou nos protegem contra) um apocalipse real de robôs. Isso torna o que eles têm a dizer sobre a ameaça existencial que o trabalho deles representa para a nossa espécie bastante importante. E você, tem medo de robôs assassinos?

Alguns temem robôs com IA

O debate não é sobre a ideia geral de robôs assassinos. É sobre convergência instrumental (que é a tendência que agentes inteligentes possuem de perseguir objetivos de auto-preservação e busca de recursos). Stuart Russell, um especialista cujo currículo inclui um trabalho como professor de Ciência da Computação em Berkeley e outro na UC San Francisco como professor adjunto de cirurgia neurológica, explica isso imaginando um robô projetado para buscar café:

É trivial construir um MDP (Processo de Decisão de Markov) de brinquedo no qual a única recompensa do agente vem da busca pelo café.

Se, nesse MDP, houver outro “humano” com alguma probabilidade, por menor que seja, de desligar o agente, e se o agente tiver disponível um botão que o desligue, o agente necessariamente pressionará esse botão como parte do processo da solução ideal para buscar o café.

Sem ódio, sem desejo de poder, sem emoções embutidas, sem instinto de sobrevivência embutido, nada exceto o desejo de buscar o café com sucesso. Este ponto não pode ser abordado porque é uma simples observação matemática.

Este é, essencialmente, o Paperclip Maximizer de Nick Bostrom – criar uma IA que produz clipes de papel e acabará transformando o mundo inteiro em uma fábrica de clipes de papel – mas um buscador de café também funciona.

Por que não devemos ter medo de robôs assassinos?

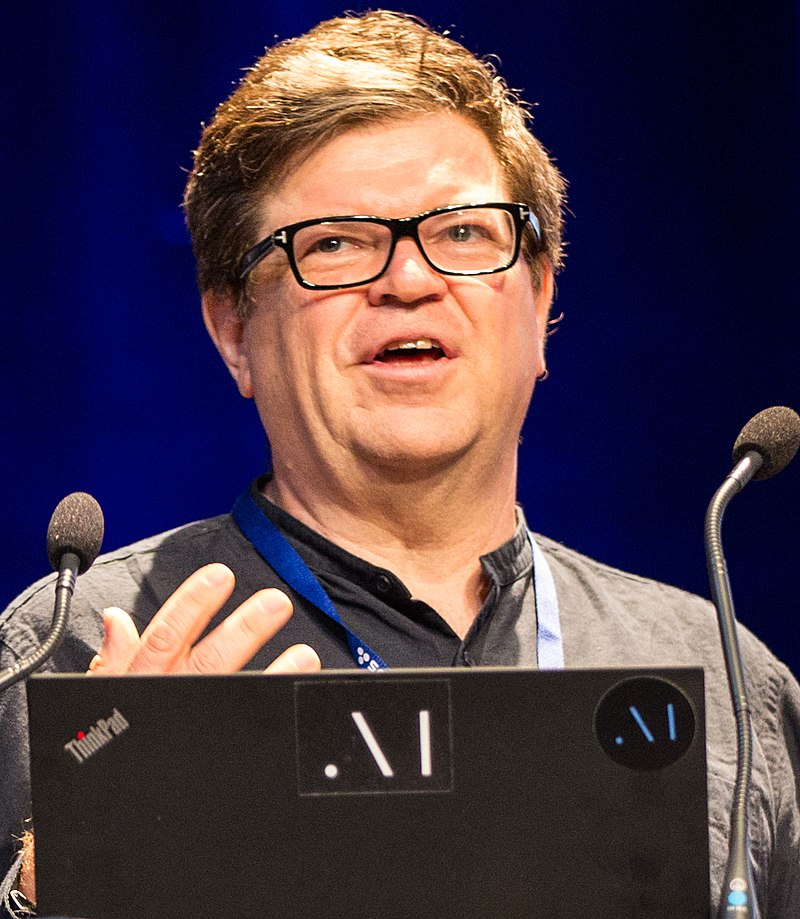

Yann LeCun, guru de IA do Facebook, e a pessoa que desencadeou o debate ao co-escrever um artigo pedindo que todos parassem de se preocupar com robôs assassinos, respondeu apresentando cinco razões pelas quais ele discorda de Stuart:

- Depois que o robô lhe traz café, seu instinto de autopreservação desaparece. Você pode desligá-lo.

- Teria de ser incrivelmente estúpido para construir objetivos em aberto em uma máquina super inteligente (e super poderosa) sem alguns termos de salvaguarda no objetivo.

- Seria preciso ser bastante incompetente para não haver um mecanismo pelo qual novos termos no objetivo pudessem ser adicionados para evitar mau comportamento anteriormente imprevisto. Para os seres humanos, temos educação e leis para moldar nossas funções objetivas e complementar os termos embutidos incorporados a nós.

- Até o poder da máquina mais super inteligente é limitado pela física, e seu tamanho e necessidades a tornam vulnerável a ataques físicos. Não há necessidade de muita inteligência aqui. Um vírus é infinitamente menos inteligente que você, mas ainda pode matá-lo.

- Uma segunda máquina, projetada exclusivamente para neutralizar uma máquina superinteligente do mal, vencerá toda vez, se receberem quantidades semelhantes de recursos de computação (porque máquinas especializadas sempre superam as gerais).

Robôs não vão dominar a humanidade

Stuart e outros que concordam com ele não veem o problema da mesma maneira. Eles argumentam que, assim como as mudanças climáticas, ameaças existenciais podem surgir de sistemas não inerentemente projetados para serem “prejudiciais”, mas protocolos adequados podem ter evitado o problema em primeiro lugar. Isso faz sentido, mas o ponto de vista alternativo colocado em um livro por Gary Marcus, da NYU:

No mundo real, os robôs atuais lutam para virar as maçanetas. É como se as pessoas do século XIV estivessem preocupadas com acidentes de trânsito, onde uma boa higiene poderia ter sido muito mais útil.

Por fim, como acontece com qualquer coisa no campo da ciência, se devemos nos preocupar com ameaças existenciais, como robôs assassinos, ou se concentrar em questões imediatas, como preconceitos e regulação da IA, depende de como você enquadra a questão.

Assim, quanto tempo, energia e outros recursos você coloca em um problema que é apenas teórico e, segundo muitas estimativas de especialistas, tem uma chance muito próxima de zero de ocorrer?

Neste artigo, você viu por que não devemos ter medo de robôs assassinos.

Se gostou, não deixe de compartilhar!

Fonte: The Next Web

Leia também: 7 melhores softwares livres para robótica no Linux