Nos últimos dias, a comunidade de inteligência artificial foi surpreendida por indícios de que a OpenAI pode estar prestes a lançar seus primeiros modelos open source — ou, mais precisamente, de peso aberto. Os nomes gpt-oss-20b e gpt-oss-120b apareceram na plataforma HuggingFace, acendendo o sinal de alerta (ou de entusiasmo) entre desenvolvedores e pesquisadores que há anos cobram mais abertura da empresa.

Este artigo explora o que foi descoberto, o que significa um modelo de peso aberto, como esses supostos modelos se posicionam frente à concorrência e quais seriam os possíveis interesses estratégicos da OpenAI com essa mudança. Afinal, a empresa que carrega “open” no nome vem sendo criticada justamente por sua postura cada vez mais fechada em relação à IA.

Se confirmado, esse movimento pode representar uma reviravolta significativa para o setor — e, quem sabe, um novo capítulo na guerra dos modelos de IA.

O que foi descoberto? Os detalhes do vazamento

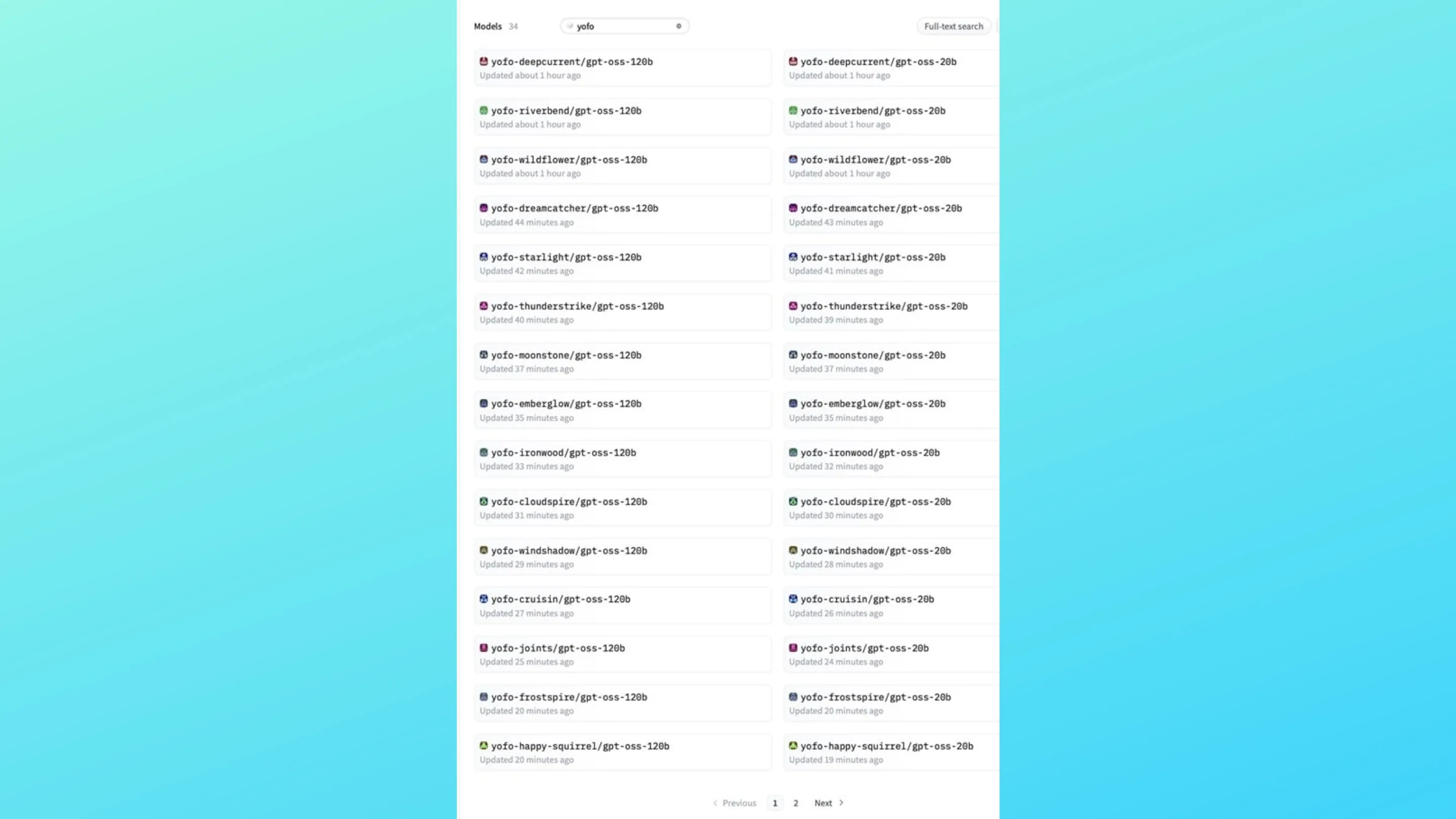

A origem do rumor está em registros encontrados na HuggingFace, plataforma amplamente utilizada pela comunidade de IA para hospedagem e compartilhamento de modelos e conjuntos de dados. Lá, usuários notaram entradas para dois modelos supostamente atribuídos à OpenAI: gpt-oss-20b e gpt-oss-120b.

A HuggingFace é considerada o GitHub da inteligência artificial, servindo como ponto central para o ecossistema open-source. Embora qualquer usuário possa criar entradas na plataforma, essas referências específicas levantaram suspeitas porque o nome “gpt-oss” e os tamanhos indicados (20B e 120B) sugerem algo grande — e possivelmente real.

Vale destacar que empresas frequentemente testam ou liberam seus modelos na HuggingFace em ambientes restritos antes de anunciar publicamente, o que fortalece a hipótese de que há algo em desenvolvimento nos bastidores.

O que significa um modelo de “peso aberto” e por que isso importa?

Um modelo de peso aberto (ou open-weight model) refere-se a um modelo cujos pesos — os parâmetros aprendidos durante o treinamento — são disponibilizados ao público, geralmente sob uma licença que permite experimentação, modificação e redistribuição.

Isso diferencia-se do modelo fechado tradicional, como os da própria OpenAI, nos quais os modelos são acessados apenas por meio de uma API paga, sem acesso ao código ou aos pesos.

A vantagem dos modelos open source OpenAI, caso se concretizem, seria imensa para a comunidade, permitindo:

- Custos reduzidos: possibilidade de rodar localmente ou em nuvens mais baratas;

- Transparência: inspeção e auditoria do comportamento do modelo;

- Personalização: ajustes específicos para casos de uso próprios;

- Avanço científico: colaboração em melhorias e testes reproduzíveis.

Esse modelo de distribuição tem sido adotado por concorrentes como a Meta, com o Llama 3, e pela Mistral, cuja abordagem aberta conquistou rapidamente a comunidade técnica.

Análise dos possíveis modelos: o que os nomes 20B e 120B nos dizem

Os sufixos “20B” e “120B” nos nomes gpt-oss-20b e gpt-oss-120b indicam a quantidade de parâmetros do modelo. Parâmetros são as unidades fundamentais que determinam a complexidade e a capacidade de um modelo de linguagem.

O gpt-oss-20b

Com 20 bilhões de parâmetros, este modelo se posicionaria acima de modelos como o Mistral 7B e o Llama 3 8B, oferecendo mais capacidade de raciocínio e geração de texto.

Ainda assim, estaria dentro de uma faixa que permite ser executado por empresas e laboratórios com infraestrutura moderada, especialmente se treinado com técnicas eficientes de compressão ou quantização. É o tipo de modelo que pode atender desde chatbots personalizados até aplicações industriais.

O gpt-oss-120b

Com impressionantes 120 bilhões de parâmetros, este modelo se aproximaria do território dos grandes modelos de fundação, como o Llama 3 70B ou mesmo o GPT-3 original da própria OpenAI, que possuía 175B.

Um modelo desse porte, se realmente for open-weight, representaria um divisor de águas, pois poucas empresas disponibilizam modelos tão grandes abertamente, dada a complexidade e os custos de treinamento.

Se eficiente e bem treinado, o gpt-oss-120b poderia rivalizar com soluções comerciais e avançadas, oferecendo uma alternativa poderosa e livre às APIs proprietárias.

A estratégia da OpenAI: por que agora?

Ainda não há confirmação oficial da OpenAI, mas vários fatores sugerem que a empresa pode estar recalculando sua rota:

- Pressão da concorrência: Empresas como a Meta (com o Llama 3), Mistral, Cohere, Anthropic e até o Google (com o Gemma) vêm ganhando espaço ao adotar modelos abertos, atraindo desenvolvedores e gerando ecossistemas vibrantes.

- Críticas à perda de propósito original: Fundada com o ideal de abertura e benefício social da IA, a OpenAI tem sido criticada por seu fechamento e foco em lucro. Um movimento de abertura pode ser uma tentativa de recuperar credibilidade.

- Estratégia de “funil”: Disponibilizar modelos abertos pode atrair desenvolvedores e startups para o ecossistema da OpenAI, que podem migrar naturalmente para modelos mais potentes e pagos, como o futuro GPT-5.

- Controle de narrativa: Lançar modelos open-weight permite à OpenAI manter relevância no mundo open-source, moldando os padrões de uso e evitando que outras plataformas dominem essa frente.

Conclusão: um rumor com potencial de terremoto

Se confirmado, o lançamento dos modelos gpt-oss-20b e gpt-oss-120b poderá marcar o início de uma nova fase para a OpenAI — mais aberta, mais colaborativa e estrategicamente alinhada com as demandas da comunidade.

Ainda é cedo para afirmar com certeza se os vazamentos são reais ou se os modelos serão realmente liberados com pesos acessíveis ao público. Mas o simples indício já chacoalhou o mercado e reacendeu o debate sobre o equilíbrio entre inovação, abertura e lucro no universo da inteligência artificial.

E você, o que acha dessa possível mudança da OpenAI? Seria uma jogada estratégica inteligente ou um sinal de enfraquecimento diante da concorrência? Deixe sua opinião nos comentários e continue acompanhando o SempreUpdate para atualizações sobre esse possível marco histórico.