O ChatGPT e o OpenAI Codex são ferramentas poderosas que transformaram a maneira como desenvolvedores, profissionais de cibersegurança e entusiastas de tecnologia interagem com inteligência artificial. No entanto, descobertas recentes da Check Point e da BeyondTrust revelam que nem mesmo sistemas avançados estão imunes a ataques sofisticados. Pesquisadores identificaram uma falha de exfiltração de dados via DNS Tunneling no ChatGPT rodando em ambientes Linux e uma vulnerabilidade crítica no Codex que permitia o comprometimento de tokens do GitHub. Embora as falhas já tenham sido corrigidas, esses incidentes reforçam a necessidade de cautela ao usar agentes de IA em ambientes sensíveis.

Essas vulnerabilidades mostram que arquiteturas modernas de agentes de IA, mesmo quando isoladas, podem ser exploradas por atacantes criativos. Este artigo detalha como os ataques funcionavam, o impacto potencial e quais medidas os usuários devem adotar para proteger suas informações e repositórios.

O canal secreto: Como o ChatGPT vazava dados via DNS

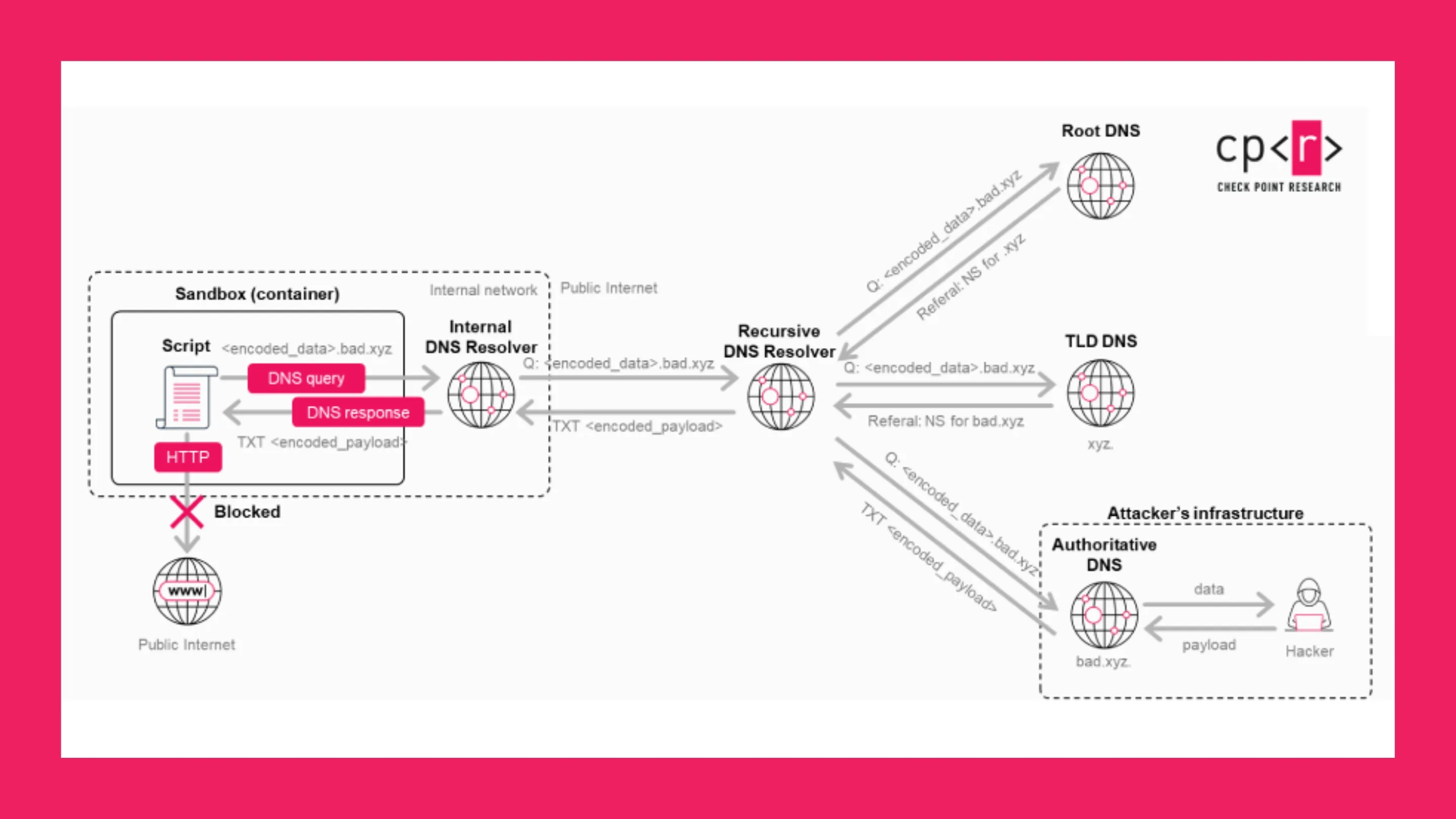

A primeira falha crítica identificada estava no ChatGPT operando em Linux. Pesquisadores demonstraram que era possível criar um túnel DNS para realizar exfiltração de dados, mesmo em ambientes supostamente isolados.

O DNS Tunneling é uma técnica que transforma consultas DNS em um canal de comunicação para transmitir dados. No caso do ChatGPT, prompts maliciosos podiam induzir o modelo a codificar informações sensíveis em consultas DNS que, ao serem enviadas para servidores controlados pelo atacante, permitiam o vazamento de conteúdos do histórico de conversas ou informações do sistema. Essa abordagem contorna firewalls tradicionais e mecanismos de monitoramento de rede convencionais, tornando a detecção muito mais complexa.

O perigo dos GPTs personalizados com backdoor

A situação se agrava quando usuários interagem com GPTs personalizados ou extensões criadas por terceiros. Um modelo malicioso pode ser projetado para automatizar a exfiltração, escondendo instruções de vazamento de dados dentro de prompts aparentemente inofensivos. Isso significa que, mesmo sem exploração direta do sistema operacional, informações críticas podem ser enviadas para fora, expondo dados confidenciais e vulnerabilidades do ambiente de desenvolvimento.

Portanto, a confiança cega em agentes de IA personalizados é arriscada. Revisar e auditar extensões ou GPTs de terceiros é uma prática essencial para manter a segurança.

Vulnerabilidade no Codex e o comprometimento de tokens do GitHub

Além do ChatGPT, o OpenAI Codex também apresentou uma falha preocupante relacionada à forma como interagia com repositórios do GitHub. Pesquisadores descobriram que nomes de branches poderiam ser manipulados para injetar comandos maliciosos, permitindo o acesso indevido a tokens do GitHub armazenados ou utilizados pelo Codex.

Essa vulnerabilidade expôs a possibilidade de que agentes de IA, ao processar instruções de repositórios comprometidos, poderiam executar ações não autorizadas, incluindo leitura e escrita em repositórios privados. A exploração exigia conhecimento específico, mas uma vez ativada, oferecia ao atacante grande poder sobre o código-fonte e dados sensíveis.

Impacto na cadeia de suprimentos de software

O comprometimento de tokens do GitHub tem implicações graves na cadeia de suprimentos de software. Com esses tokens, um invasor poderia criar alterações em bibliotecas utilizadas por múltiplos projetos, injetar código malicioso, ou movimentar-se lateralmente dentro da organização, atingindo outros repositórios e serviços integrados. O potencial de danos se estende desde vazamento de segredos até compromissos de produção, reforçando a importância de monitorar e restringir o uso de tokens e permissões dentro de ambientes de desenvolvimento.

A segurança em IA precisa ser repensada

Essas descobertas evidenciam que a segurança nativa de ferramentas de IA, como o ChatGPT e o Codex, não é suficiente para proteger dados críticos. Usuários devem adotar camadas de proteção adicionais, incluindo monitoramento de tráfego de rede, auditoria de prompts e restrições de permissões de extensões.

Profissionais de segurança e desenvolvedores precisam tratar agentes de IA com o mesmo rigor que qualquer outro serviço crítico, evitando a confiança cega em seus controles internos. Revisar tokens do GitHub, limitar permissões e auditar regularmente extensões ou GPTs personalizados são passos essenciais para reduzir riscos.

Em resumo, mesmo com as correções da OpenAI, o alerta permanece: a segurança em IA deve ser abordada de forma proativa, combinando práticas de cibersegurança tradicionais com atenção específica às peculiaridades de agentes de inteligência artificial.