A febre da Inteligência Artificial continua em alta, mas onde há popularidade, também há golpistas. Aplicativos que se passam pelo ChatGPT da OpenAI não são novidade, mas uma nova onda está conseguindo enganar usuários e até mesmo os sistemas de revisão da Mac App Store. Essa situação exige atenção redobrada, principalmente para quem utiliza dispositivos Apple no dia a dia.

Recentemente, a descoberta de clones falsos do ChatGPT na App Store acendeu a luz amarela para especialistas em segurança. Esses aplicativos enganosos estão subindo rapidamente nas listas de mais vendidos, explorando a curiosidade e confiança de usuários menos atentos. Mais do que apenas enganar, eles representam um risco direto à privacidade de dados pessoais e profissionais.

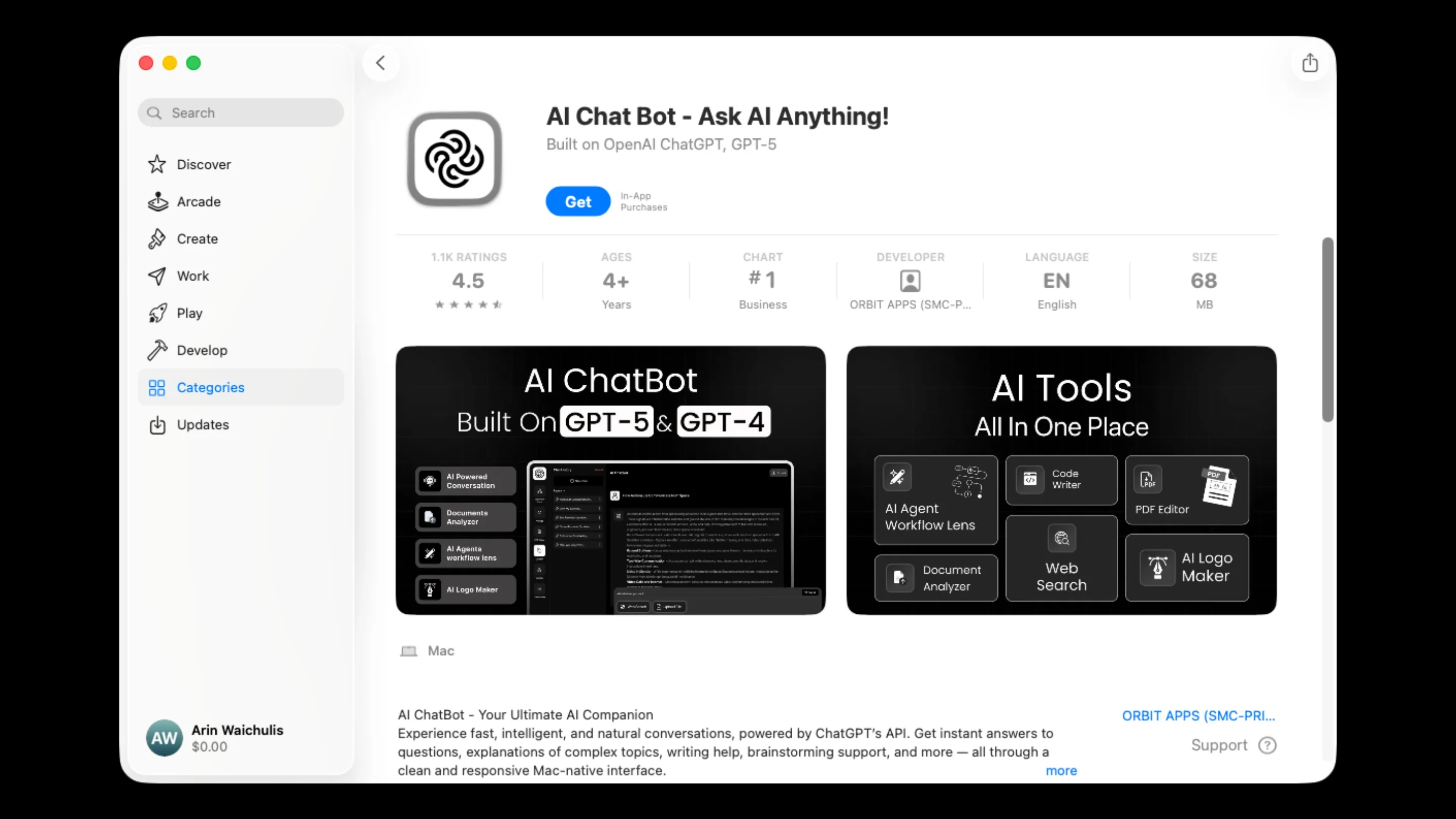

O alerta foi reforçado pelo pesquisador de segurança Alex Kleber, que notou que um desses clones chegou ao topo da categoria “Negócios”. A investigação, reportada pelo 9to5Mac, mostrou que essas imitações usam estratégias sofisticadas de branding para parecerem legítimas, colocando em risco a confiança dos consumidores na própria App Store.

O golpe: como aplicativos falsos de IA estão enganando usuários (e a Apple)

O principal método desses aplicativos é o mimetismo. Eles copiam o logotipo, o nome e até o design do ChatGPT ou de outros produtos da OpenAI, criando a ilusão de legitimidade.

Segundo Alex Kleber, o aplicativo número um na categoria “Negócios” do macOS era um impostor. Ele e outro aplicativo quase idêntico vinham da mesma conta de desenvolvedor, localizada no Paquistão, e usavam um site de suporte gratuito do Google, dando a falsa impressão de profissionalismo.

Essa situação evidencia uma falha no processo de revisão da Apple. Embora a empresa tenha reforçado suas políticas contra imitações, ainda é possível que aplicativos enganosos passem despercebidos e coloquem os usuários em risco.

O perigo real não é o app, são os seus dados

O maior risco de baixar um clone do ChatGPT na App Store não é pagar por um aplicativo que, na prática, apenas usa a API do ChatGPT — muitas vezes até de forma gratuita. O problema real está na coleta excessiva de dados dos usuários.

Os rótulos de privacidade da App Store estão falhando

A Apple introduziu os rótulos de privacidade para oferecer mais transparência sobre quais dados os aplicativos coletam. No entanto, esses rótulos são auto-relatados pelos desenvolvedores, sem verificação robusta. Isso significa que a empresa depende da honestidade de quem publica o aplicativo.

Um relatório recente da Private Internet Access (PIA) revelou que muitos aplicativos de produtividade e IA coletam silenciosamente muito mais informações do que informam. Dados como nome, e-mail, estatísticas de uso e ID de dispositivo são frequentemente capturados, sem que o usuário saiba.

O que acontece com suas conversas?

O alerta do 9to5Mac descreve a situação como uma “receita para o desastre”. Imagine todas as suas interações com o chatbot — que podem incluir dados pessoais, profissionais ou sensíveis — sendo armazenadas em um banco de dados duvidoso de uma empresa de fachada. Esse tipo de coleta transforma conversas privadas em uma potencial mina de informações para criminosos.

Como identificar e evitar aplicativos de IA fraudulentos

A aprovação da App Store ou uma boa classificação não garantem segurança. Para se proteger, é necessário adotar uma postura crítica:

- Verifique o desenvolvedor: Antes de baixar, clique no nome do desenvolvedor. É uma empresa conhecida, como OpenAI ou Microsoft, ou um nome desconhecido com site suspeito? Sites gratuitos do Google são um alerta.

- Use os aplicativos oficiais: O ChatGPT oficial é da OpenAI. Para o Copilot (que usa GPT-4), prefira a versão da Microsoft.

- Desconfie de nomes genéricos: Apps chamados “Chatbot AI” ou “Assistente GPT” podem estar tentando se aproveitar do sucesso da marca sem autorização.

- Leia as avaliações com cautela: Muitas avaliações podem ser falsas. Prefira comentários detalhados que mencionem problemas de privacidade, cobranças indevidas ou falhas no funcionamento.

Conclusão: a segurança da IA começa com você

A conveniência da IA é inegável, mas ela também se tornou um novo vetor para golpes digitais. A presença de clones falsos do ChatGPT na App Store prova que nem mesmo ecossistemas controlados, como o da Apple, estão livres de riscos.

A responsabilidade final recai sobre o usuário. Sempre verifique a autenticidade do aplicativo antes de baixar e trate suas conversas de IA com o mesmo cuidado que teria com e-mails ou dados bancários.

Você já encontrou algum aplicativo suspeito de IA na App Store? Compartilhe sua experiência nos comentários e ajude a alertar outros usuários.