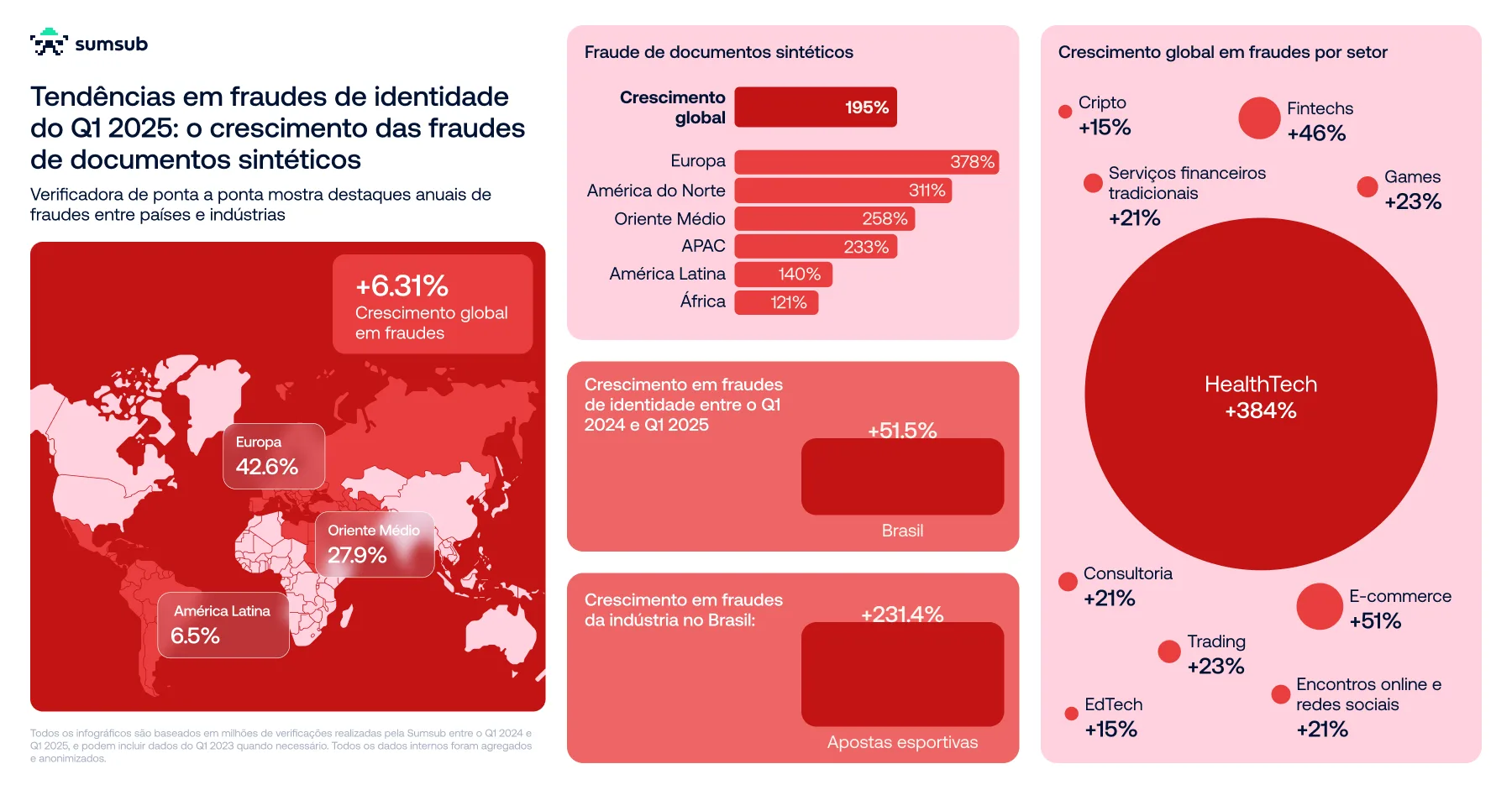

A explosão das fraudes com deepfake e identidade sintética já não é mais um alerta distante de laboratórios de pesquisa acadêmica. Em questão de meses, as tentativas de golpe que combinam imagens geradas por IA, vozes clonadas e documentos digitais forjados migraram de fóruns obscuros para o cotidiano das empresas — e, sobretudo, do usuário final. A Sumsub, plataforma de verificação de identidade utilizada por bancos, fintechs e casas de apostas, revela que, entre o 1º trimestre de 2024 e o 1º trimestre de 2025, o número de ataques baseados em deepfake disparou 700 % no mundo. O Brasil, centro nervoso dessa crise, enfrenta uma frequência de ocorrências cinco vezes maior que a dos EUA e dez vezes a da Alemanha.

Para quem ainda associa golpes de identidade a “Photoshop de baixo nível” ou reimpressões malfeitas, a nova realidade é bem diferente. Os falsários agora usam modelos generativos avançados para criar CNHs e RGs de aparência perfeita, ou para simular em vídeo o rosto de alguém lendo frases previamente capturadas de redes sociais públicas. Com isso, métodos clássicos de fraude — que dependiam de rasgar e colar pedaços de documentos — despencam na América Latina: segundo a Sumsub, houve uma queda de 64 % nas falsificações “analógicas”. Em contrapartida, as tentativas de identidade sintética no Brasil saltaram 140 %, elevando a taxa total de fraudes nacionais em 51,5 % somente em 2025.

A ascensão meteórica das fraudes com deepfake e identidade sintética

Em termos simples, deepfake é qualquer conteúdo audiovisual criado ou alterado por Inteligência Artificial (IA) para imitar pessoas reais. Isso inclui vídeos inteiros que colocam uma identidade não autorizada fazendo gestos e falas críveis, ou apenas uma selfie animada para burlar reconhecimento facial. A identidade sintética, por sua vez, não duplica uma vítima existente; ela combina dados verídicos e falsos (CPF de terceiro, foto gerada por IA, endereço real de prédio abandonado) para formar um “novo cidadão digital” que não pode contestar a fraude porque, tecnicamente, não existe.

O problema de 2024 para 2025 não foi só de volume, mas de aprendizado de máquina. A cada documento recusado, técnicas de reinforcement learning recompensam o golpista com feedback sobre quais pixels, fontes ou microimpressões falharam na validação. Na iteração seguinte, a probabilidade de sucesso cresce ― e, quando passam, esses modelos são vendidos como “fraude‑as‑a‑service” em marketplaces clandestinos. Mas é importante destacar que você pode identificar e se proteger da fraude.

O crescimento exponencial: 700% globalmente e o cenário alarmante no Brasil

A estatística de 700 % global reflete que os controles de KYC (Know Your Customer) tradicionais não acompanham o passo das GANs (Generative Adversarial Networks) lançadas no último ano. No Brasil, três fatores agravam o quadro:

- Popularização do e‑commerce e de carteiras digitais sem contato presencial.

- Inclusão bancária rápida, somando milhões de contas novas que precisam de onboarding remoto.

- Regulamentações emergentes (como o recém‑criado mercado de apostas esportivas online) que exigem verificação, mas nem sempre padronizam métricas mínimas de segurança.

Esse contexto tornou o país um campo de provas para fraudadores que, antes de atacar mercados mais maduros, preferem validar seus kits em regiões onde custos processuais e demoras judiciais reduzem riscos de punição.

A mudança de paradigma: Da falsificação tradicional para a inteligência artificial

Enquanto falsificações manuais caíram 64 % na América Latina, a lacuna foi preenchida por algoritmos generativos que:

- Capturam templates de documentos vazados em fóruns de data breach.

- Ajustam watermarks, hologramas e padrões UV através de redes neurais treinadas em bases públicas de imagens de identidade.

- Inserem dados variáveis (nome, data de nascimento) em campos dinâmicos sem distorcer microtextos.

O resultado é um documento que, quando fotografado, engana OCRs (Optical Character Recognition) e muitas vezes até peritos humanos despreparados para identificar inconsistências de código de barras 2D, QR Codes ou zonas MRZ.

O mapa das fraudes: Impacto por indústria e vetores de ataque

A Sumsub mapeia nove setores críticos, e todos registram alta relevante. Contudo, vetores e motivos variam:

| Indústria | Aumento percentual (T1 2024 → T1 2025) | Fraude sobre total de verificações |

|---|---|---|

| Apostas esportivas | 231,4 % | 1,16 % |

| Encontros online e redes sociais | 169,3 % | 4,47 % |

| Fintech | 143,2 % | 1,80 % |

| Serviços financeiros tradicionais | 136,8 % | 1,35 % |

| Gaming | 70,8 % | 1,52 % |

| Trading | 64,4 % | 0,74 % |

| E‑commerce | 56,9 % | 1,82 % |

| Edtech | 52,9 % | 1,33 % |

| Serviços profissionais e de consultoria | 52,7 % | 1,39 % |

Observação crítica: mesmo indústrias “moderadas” em volume, como e‑commerce e gaming, exibem taxas acima de 1 %, o que indica que uma em cada cem tentativas de cadastro ou compra carrega risco de ser fraude confirmada.

Fraude por identidade sintética: O método crescente que desafia a verificação

Identidade sintética é particularmente eficaz porque passa despercebida em listas de sanções e em bancos de dados de pessoas politicamente expostas (PEPs). Como não há vítima direta, denúncias tardam; e quando surgem, o CPF normalmente pertence a um “laranja” que desconhece a extensão do uso. No Brasil, o aumento de 140 % dessa técnica deve‑se a:

- Dados pessoais vazados de bases do governo ou de varejistas.

- Ferramentas de deep learning hospedadas em nuvem pública, muitas com APIs baratas.

- Ausência de cadastro biométrico unificado, tornando difícil cruzar faces sintéticas com fotos oficiais.

Setores mais atingidos: Apostas, encontros online e redes sociais, fintechs e serviços financeiros

- Apostas esportivas: Fraudes visam bônus de boas‑vindas, cash‐outs ilícitos e lavagem de ganhos. Cada conta falsa pode gerar dezenas de tentativas antes de bloqueio.

- Encontros online e redes sociais: Perfis deepfake conquistam confiança, coletam dados e promovem golpes de “romance scam” ou extorsão.

- Fintechs: Contas digitais com PIX facilitam ciclagem de valores oriundos de fraudes e golpes de WhatsApp.

- Serviços financeiros tradicionais: Apesar de regulamentados, veem alta porque fraudadores migram para linhas de crédito e cartões emergenciais quando barrados pelas fintechs.

As taxas preocupantes em namoro online, jogos e e‑commerce

- Namoro online: Com 4,47 % de fraudes, plataformas precisam rever proof of life em vídeo e monitorar comportamento conversacional para detectar catfishing automatizado.

- Gaming: Além de compra e revenda de moedas virtuais, criminosos criam contas clonadas para boosting ou tráfico de skins.

- E‑commerce: Cartões virtuais emitidos em nome de identidades sintéticas resultam em chargebacks custosos e perdas de estoque.

O cenário das apostas no Brasil: Riscos e a linha de defesa ética da tecnologia

A rápida expansão do setor e o aumento das fraudes de identidade

O mercado brasileiro de iGaming saltou após regulamentação parcial em 2023–2024. Bônus agressivos, transmissões de streamers e marketing massivo impulsionaram milhões de cadastros. Consequência: em 2025, a taxa de fraude de identidade nas apostas subiu 231 % e já responde por 1,16 % de todas as verificações suspeitas.

Novas regras da SPA e o papel da verificação de identidade obrigatória

A Secretaria de Prêmios e Apostas (SPA), órgão do Ministério da Fazenda, exige que operadoras:

- Implementem verificação de identidade em dois níveis: documento e biometria.

- Bloqueiem contas de menores de idade com evidências de proxy ou VPN.

- Reportem tentativas de lavagem de dinheiro acima de thresholds diários.

Descumprir essas normas implica multas milionárias e até cassação de licença.

Tecnologia e IA como aliados éticos: Barrando o uso indevido e a lavagem de dinheiro

Para Kris Galloway, Head de produtos de iGaming da Sumsub, as mesmas tecnologias que armam criminosos também podem blindar as empresas. Soluções de liveness detection em tempo real, análise de redes neurais para padrões de clique e cross‑device fingerprinting são capazes de:

- Identificar rostos sintéticos mesmo quando eles “mexem” olhos e boca com alta fidelidade.

- Correlacionar geolocalização inconsistente ao processo de captura.

- Explorar modelos de risco adaptativo para reforçar autenticação em transações suspeitas.

Desafios e o futuro da cibersegurança: Adaptando‑se à era da IA na fraude

A sofisticação dos criminosos impulsionada pela inteligência artificial

Modelos open source como Stable Diffusion e SDXL já geram documentos no padrão 300 dpi usados por gráficas legais. Além disso, serviços de voice cloning ajustam sotaque brasileiro em segundos. Em vídeos, deepfake de “classe B” (60 fps, resolução 720p) basta para burlar muitos gatekeepers de selfie ID que se baseiam em detecção de vida passiva.

A urgência da adaptação: Estratégias para empresas e reguladores

- Camadas múltiplas de verificação: Documento + selfie + biometria comportamental + análise de dispositivo.

- Monitoramento contínuo: Não basta “KYC na entrada”. Event‑driven checks, como primeiro saque ou alteração de perfil, reduzem risco.

- Compartilhamento de inteligência: Consórcios setoriais podem trocar hashes de deepfakes e IPs maliciosos sem violar LGPD.

- Educação de usuários: Guias claros sobre risco de identidade sintética reduzem propensão a golpes de engenharia social.

- Regulação ágil: Sandboxes regulatórias permitem testar APIs de anti‑synthetic ID sem comprometer conformidade.

Conclusão: A vigilância e a inovação são cruciais para combater as fraudes deepfake e de identidade sintética

O tsunami de 700 % em fraudes movidas a IA confirma que deepfake e identidade sintética não são uma curiosidade futurista, mas o presente da cibercriminalidade. O Brasil, posicionado na linha de frente desse desafio, precisa alinhar empresas, órgãos reguladores e consumidores em torno de uma mesma premissa: confiança não se herda, constrói‑se continuamente. Ferramentas de verificação de identidade ponta a ponta, auditorias regulares de modelos de IA e legislação adaptável formam o tripé para conter fraudes hoje — e mitigar as que ainda virão. Entre a engenhosidade criminosa e a criatividade defensiva, vencerá quem inovar mais rápido, sem esquecer o pilar ético que sustenta a confiança digital.