A tecnologia revolucionária das ferramentas de IA generativas como o ChatGPT, trouxe riscos significativos aos dados confidenciais das organizações. Inclusive, uma nova pesquisa da empresa de segurança de navegador LayerX lança luz sobre o escopo e a natureza desses riscos, apontando que 6% dos funcionários colam dados confidenciais em ferramentas como ChatGPT.

O relatório intitulado “Revealing the True GenAI Data Exposure Risk” fornece informações cruciais para as partes interessadas na proteção de dados e as capacita a tomar medidas proativas.

Os números por trás do risco do ChatGPT: dados confidenciais de empresas podem estar sendo comprometidos

Ao analisar o uso do ChatGPT e outros aplicativos generativos de IA entre 10.000 funcionários, o relatório identificou as principais áreas de preocupação. Uma descoberta alarmante revela que 6% dos funcionários colaram dados confidenciais no GenAI, com 4% envolvidos nesse comportamento de risco semanalmente. Essa ação recorrente representa uma grave ameaça de exfiltração de dados para as organizações.

O relatório aborda questões importantes de avaliação de risco, incluindo o escopo real do uso do GenAI nas forças de trabalho da empresa, a participação relativa das ações de “colar” nesse uso, o número de funcionários que colam dados confidenciais no GenAI e sua frequência, os departamentos que mais utilizam o GenAI, e os tipos de dados confidenciais com maior probabilidade de serem expostos por meio de colagem.

O uso e a exposição de dados estão aumentando

Uma descoberta impressionante é um aumento de 44% no uso de GenAI apenas nos últimos três meses. Apesar desse crescimento, apenas uma média de 19% dos funcionários de uma organização atualmente utiliza as ferramentas GenAI. No entanto, os riscos associados ao uso do GenAI permanecem significativos, mesmo em seu nível atual de adoção.

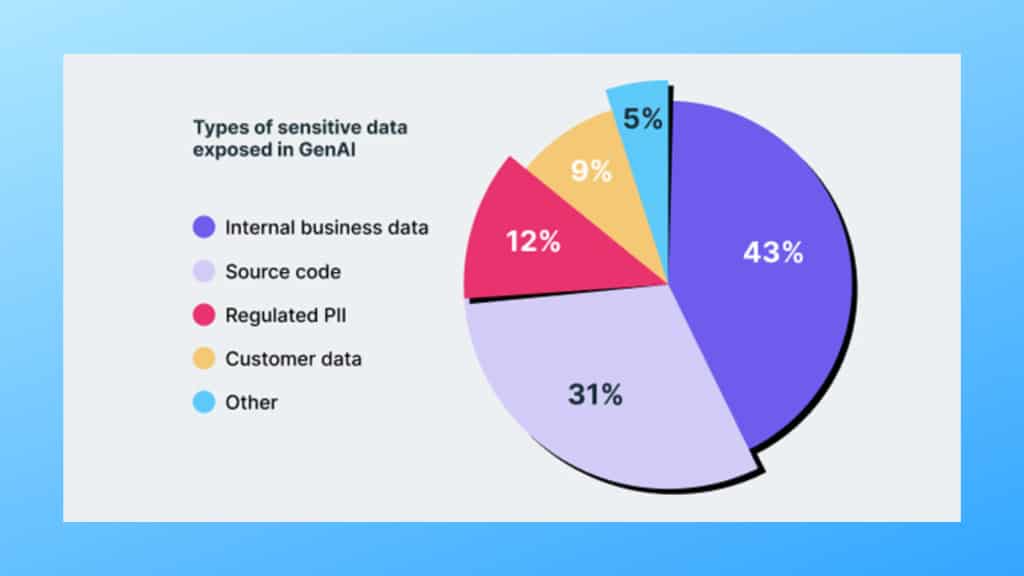

A pesquisa também destaca a prevalência de exposição a dados confidenciais. Dos funcionários que usam o GenAI, 15% se dedicam a colar dados, com 4% semanalmente e 0,7% várias vezes por semana. Esse comportamento recorrente ressalta a necessidade urgente de medidas robustas de proteção de dados para evitar o vazamento de dados. Código-fonte, informações comerciais internas e informações pessoais identificáveis ??(PII) são os principais tipos de dados confidenciais colados.

As partes interessadas na proteção de dados podem aproveitar os insights fornecidos pelo relatório para criar planos de proteção de dados GenAI eficazes. Na era do GenAI, é crucial avaliar a visibilidade dos padrões de uso do GenAI dentro de uma organização e garantir que os produtos existentes possam fornecer os insights e a proteção necessários.