A tecnologia avança rapidamente e o uso da Inteligência Artificial impressiona em vários aspectos. Um deles é na capacidade de recriar rostos de seres humanos quase impossíveis de diferenciar se são reais ou criados do zero. Assim, muita gente não pode mais distinguir com segurança a diferença entre um rosto humano real e uma imagem de um rosto gerada por inteligência artificial, de acordo com pesquisadores.

O estudo é de Sophie Nightingale, do Departamento de Psicologia da Lancaster University, no Reino Unido, e Hany Farid, do Departamento de Engenharia Elétrica e Ciências da Computação de Berkley, na Califórnia. Ambos estudaram avaliações humanas de fotografias reais e imagens sintetizadas por IA. A conclusão é de que não é possível para nós percebermos as diferenças.

Em uma parte do estudo – publicado no Proceedings of the National Academy of Sciences USA – os humanos identificaram imagens falsas em apenas 48,2% das ocasiões.

Em outra parte do estudo, os participantes receberam algum treinamento e feedback para ajudá-los a identificar as falsificações. Embora essa coorte tenha detectado humanos reais 59% das vezes, seus resultados se estabilizaram nesse ponto.

Verdadeiro ou falso? IA cria rostos tão reais que os humanos não conseguem perceber diferença

A terceira parte do estudo viu os participantes classificarem os rostos como “confiáveis” em uma escala de um a sete. Rostos falsos foram classificados como mais confiáveis do que os reais.

“Um rosto sorridente é mais provável de ser classificado como confiável, mas 65,5% dos nossos rostos reais e 58,8% dos rostos sintéticos estão sorrindo, então a expressão facial por si só não pode explicar por que os rostos sintéticos são classificados como mais confiáveis”, escreveram os pesquisadores. .

As imagens falsas foram formadas usando redes adversariais generativas (GANs). Trata-se de uma classe de frameworks de aprendizado de máquina onde duas redes neurais jogam um tipo de competição uma com a outra até que a rede se treine para criar um conteúdo melhor.

Como o rosto é criado

A técnica começa com uma matriz aleatória de pixels e aprende a criar uma face. Um discriminador, enquanto isso, aprende a detectar a face sintetizada após cada iteração. Se for bem-sucedido, penaliza o gerador. Eventualmente, o discriminador não pode dizer a diferença entre rostos reais e sineteses e aparentemente nem um humano.

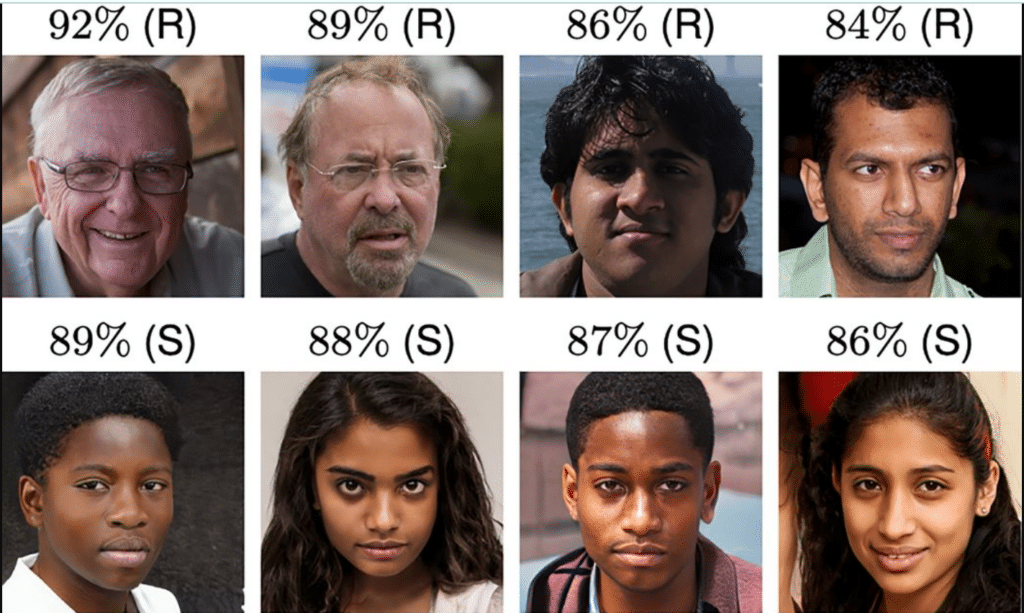

As imagens finais usadas no estudo incluíram um conjunto diversificado de 400 rostos reais e 400 rostos sintetizados representando rostos negros, sul-asiáticos, asiáticos orientais e brancos. Rostos masculinos e femininos foram incluídos – ao contrário de estudos anteriores que usaram principalmente rostos masculinos brancos.

Os rostos brancos foram os menos classificados com precisão, e os rostos brancos masculinos foram classificados com ainda menos precisão do que os brancos femininos.

Nós levantamos a hipótese de que os rostos brancos são mais difíceis de classificar porque estão super-representados no conjunto de dados de treinamento do StyleGAN2 e, portanto, são mais realistas, explicaram os pesquisadores.

Tecnologia para o bem e para o mal

Os cientistas disseram que, embora a criação de rostos realistas seja um sucesso, também cria problemas potenciais. É o caso de imagens íntimas não consensuais (muitas vezes chamadas erroneamente de “pornografia de vingança”), fraude e campanhas de desinformação como casos de uso de imagens falsas. Tais atividades, escreveram eles, têm “sérias implicações para indivíduos, sociedades e democracias”.

Os autores sugeriram que aqueles que desenvolvem tais tecnologias deveriam considerar se os benefícios superam os riscos. E se não superarem, simplesmente não devem criar a tecnologia. Talvez depois de reconhecer que a tecnologia com grandes desvantagens é irresistível para alguns, eles recomendaram o desenvolvimento paralelo de salvaguardas. Isso inclui diretrizes estabelecidas que mitiguem possíveis danos causados por tecnologias de mídia sintética.

Atualmente, existem esforços em andamento para melhorar a detecção de deepfakes e mídias similares, como a construção de um software protótipo capaz de detectar imagens feitas com redes neurais. Uma colaboração da Michigan State University (MSU) e do Facebook AI Research (FAIR) no ano passado até sugeriu a arquitetura da rede neural usada para criar as imagens.

Via The Register